Загрузка данных из Microsoft Azure Storage

Selena предоставляет следующие варианты загрузки данных из Azure:

- Синхронная загрузка с использованием INSERT+

FILES() - Асинхронная загрузка с использованием Broker Load

Каждый из этих вариантов имеет свои преимущества, которые подробно описаны в следующих разделах.

В большинстве случаев мы рекомендуем использовать метод INSERT+FILES(), который гораздо проще в использовании.

Однако метод INSERT+FILES() в настоящее время поддерживает только форматы файлов Parquet, ORC и CSV. Поэтому, если вам нужно загрузить данные других форматов файлов, таких как JSON, или выполнить изменения данных, такие как DELETE, во время загрузки данных, вы можете использовать Broker Load.

Перед началом работы

Подготовка исходных данных

Убедитесь, что исходные данные, которые вы хотите загрузить в Selena, правильно хранятся в контейнере внутри вашей учётной записи хранения Azure.

В этой теме предположим, что вы хотите загрузить данные из примера набора данных в формате Parquet (user_behavior_ten_million_rows.parquet), хранящегося в корневом каталоге контейнера (selena-container) внутри учётной записи хранен�ия Azure Data Lake Storage Gen2 (ADLS Gen2) (selena).

Проверка привилегий

Вы можете загружать данные в таблицы Selena только как пользователь, имеющий привилегию INSERT на эти таблицы Selena. Если у вас нет привилегии INSERT, следуйте инструкциям в разделе GRANT, чтобы предоставить привилегию INSERT пользователю, которого вы используете для подключения к вашему cluster Selena. Синтаксис: GRANT INSERT ON TABLE <table_name> IN DATABASE <database_name> TO { ROLE <role_name> | USER <user_identity>}.

Сбор данных аутентификации

Примеры в этой теме используют метод аутентификации Shared Key. Чтобы убедиться, что у вас есть разрешение на чтение данных из ADLS Gen2, мы рекомендуем прочитать Azure Data Lake Storage Gen2 > Shared Key (ключ доступа учётной записи хранения), чтобы понять параметры аутентификации, которые вам нужно настроить.

Вкратце, если вы используете аутентификацию Shared Key, вам нужно собрать следующую информацию:

- Имя пользователя вашей учётной записи хранения ADLS Gen2

- Shared key вашей учётной записи хранения ADLS Gen2

Для получения информации обо всех доступных методах аутентификации см. Аутентификация в облачном хранилище Azure.

Использование INSERT+FILES()

Этот метод доступен начиная с версии v1.5.2 и в настоящее время поддерживает только форматы файлов Parquet, ORC и CSV (начиная с версии v1.5.2).

Преимущества INSERT+FILES()

FILES() может читать файл, хранящийся в облачном хранилище, на основе указанных вами свойств, связанных с путём, выводить схему таблицы данных в файле, а затем возвращать данные из файла в виде строк данных.

С помощью FILES() вы можете:

- Запрашивать данные напрямую из Azure с помощью SELECT.

- Создавать и загружать таблицу с помощью CREATE TABLE AS SELECT (CTAS).

- Загружать данные в существующую таблицу с помощью INSERT.

Типичные примеры

Прямой запрос из Azure с помощью SELECT

Прямой запрос из Azure с помощью SELECT+FILES() позволяет получить хороший предварительный просмотр содержимого набора данных перед созданием таблицы. Нап�ример:

- Получить предварительный просмотр набора данных без сохранения данных.

- Запросить минимальные и максимальные значения и решить, какие типы данных использовать.

- Проверить наличие значений

NULL.

Следующий пример запрашивает пример набора данных user_behavior_ten_million_rows.parquet, хранящийся в контейнере selena-container внутри вашей учётной записи хранения selena:

SELECT * FROM FILES

(

"path" = "abfss://selena-container@selena.dfs.core.windows.net/user_behavior_ten_million_rows.parquet",

"format" = "parquet",

"azure.adls2.storage_account" = "selena",

"azure.adls2.shared_key" = "xxxxxxxxxxxxxxxxxx"

)

LIMIT 3;

Система возв�ращает результат запроса, аналогичный следующему:

+--------+---------+------------+--------------+---------------------+

| UserID | ItemID | CategoryID | BehaviorType | Timestamp |

+--------+---------+------------+--------------+---------------------+

| 543711 | 829192 | 2355072 | pv | 2017-11-27 08:22:37 |

| 543711 | 2056618 | 3645362 | pv | 2017-11-27 10:16:46 |

| 543711 | 1165492 | 3645362 | pv | 2017-11-27 10:17:00 |

+--------+---------+------------+--------------+---------------------+

ПРИМЕЧАНИЕ

Обратите внимание, что имена столбцов, возвращённые выше, предоставлены файлом Parquet.

Создание и загрузка таблицы с помощью CTAS

Это продолжение предыдущего примера. Предыдущий запрос обёрнут в CREATE TABLE AS SELECT (CTAS) для автоматизации создания таблицы с использованием вывода схемы. Это означает, что Selena выведет схему таблицы, создаст нужную вам таблицу, а затем загрузит данные в таблицу. Имена и типы столбцов не требуются для создания таблицы при использовании табличной функции FILES() с файлами Parquet, поскольку формат Parquet включает имена столбцов.

ПРИМЕЧАНИЕ

Синтаксис CREATE TABLE при использовании вывода схемы не позволяет устанавливать количество replica. Если вы используете cluster Selena с shared-nothing, установите количество replica перед созданием таблицы. Пример ниже для системы с тремя replica:

ADMIN SET FRONTEND CONFIG ('default_replication_num' = "3");

Создайте базу данных и переключитесь на неё:

CREATE DATABASE IF NOT EXISTS mydatabase;

USE mydatabase;

Используйте CTAS для создания таблицы и загрузки данных из примера набора данных user_behavior_ten_million_rows.parquet, который хранится в контейнере selena-container внутри вашей учётной записи хранения selena, в таблицу:

CREATE TABLE user_behavior_inferred AS

SELECT * FROM FILES

(

"path" = "abfss://selena-container@selena.dfs.core.windows.net/user_behavior_ten_million_rows.parquet",

"format" = "parquet",

"azure.adls2.storage_account" = "selena",

"azure.adls2.shared_key" = "xxxxxxxxxxxxxxxxxx"

);

После создания таблицы вы можете просмотреть её схему с помощью DESCRIBE:

DESCRIBE user_behavior_inferred;

Система возвращает следующий результат запроса:

+--------------+-----------+------+-------+---------+-------+

| Field | Type | Null | Key | Default | Extra |

+--------------+-----------+------+-------+---------+-------+

| UserID | bigint | YES | true | NULL | |

| ItemID | bigint | YES | true | NULL | |

| CategoryID | bigint | YES | true | NULL | |

| BehaviorType | varbinary | YES | false | NULL | |

| Timestamp | varbinary | YES | false | NULL | |

+--------------+-----------+------+-------+---------+-------+

Запросите таблицу, чтобы убедиться, что данные были загружены в неё. Пример:

SELECT * from user_behavior_inferred LIMIT 3;

Возвращается следующий результат запроса, указывающий, что данные были успешно загружены:

+--------+--------+------------+--------------+---------------------+

| UserID | ItemID | CategoryID | BehaviorType | Timestamp |

+--------+--------+------------+--------------+---------------------+

| 84 | 162325 | 2939262 | pv | 2017-12-02 05:41:41 |

| 84 | 232622 | 4148053 | pv | 2017-11-27 04:36:10 |

| 84 | 595303 | 903809 | pv | 2017-11-26 08:03:59 |

+--------+--------+------------+--------------+---------------------+

Загрузка в существующую таблицу с помощью INSERT

Вы можете захотеть настроить таблицу, в которую вставляете данные, например:

- тип данных столбца, настройку nullable или значения по умолчанию

- типы ключей и столбцы

- разбиение данных на partition и bucket

ПРИМЕЧАНИЕ

Создание наиболее эффективной структуры таблицы требует знания того, как данные будут использоваться и содержимого столбцов. Эта тема не охватывает проектирование таблиц. Для получения информации о проектировании таблиц см. Типы таблиц.

В этом примере мы создаём таблицу на основе знаний о том, как таблица будет запрашиваться, и данных в файле Parquet. Знание данных в файле Parquet можно получить, запросив файл напрямую в Azure.

- Поскольку запрос набора данных в Azure указывает, что столбец

Timestampсодержит данные, соответствующие типу данных VARBINARY, тип столбца указан в следующем DDL. - Запрашивая данные в Azure, вы можете обнаружить, что в наборе данных нет значений

NULL, поэтому DDL не устанавливает какие-либо столбцы как nullable. - На основе знаний об ожидаемых типах запросов sort key и столбец для bucket установлены на столбец

UserID. Ваш случай использования может отличаться для этих данных, поэтому вы можете решить использоватьItemIDв дополнение кUserIDили вместо него для sort key.

Создайте базу данных и переключитесь н�а неё:

CREATE DATABASE IF NOT EXISTS mydatabase;

USE mydatabase;

Создайте таблицу вручную (мы рекомендуем, чтобы таблица имела ту же схему, что и файл Parquet, который вы хотите загрузить из Azure):

CREATE TABLE user_behavior_declared

(

UserID int(11),

ItemID int(11),

CategoryID int(11),

BehaviorType varchar(65533),

Timestamp varbinary

)

ENGINE = OLAP

DUPLICATE KEY(UserID)

DISTRIBUTED BY HASH(UserID);

Отобразите схему, чтобы вы могли сравнить её с выведенной схемой, созданной табличной функцией FILES():

DESCRIBE user_behavior_declared;

+--------------+----------------+------+-------+---------+-------+

| Field | Type | Null | Key | Default | Extra |

+--------------+----------------+------+-------+---------+-------+

| UserID | int | NO | true | NULL | |

| ItemID | int | NO | false | NULL | |

| CategoryID | int | NO | false | NULL | |

| BehaviorType | varchar(65533) | NO | false | NULL | |

| Timestamp | varbinary | NO | false | NULL | |

+--------------+----------------+------+-------+---------+-------+

5 rows in set (0.00 sec)

Сравните схему, которую вы только что создали, со схемой, выведенной ранее с помощью табличной функции FILES(). Посмотрите на:

- типы данных

- nullable

- ключевые поля

Для лучшего контроля схемы целевой таблицы и лучшей производительности запросов мы рекомендуем указывать схему таблицы вручную в производственных средах.

После создания таблицы вы можете загрузить её с помощью INSERT INTO SELECT FROM FILES():

INSERT INTO user_behavior_declared

SELECT * FROM FILES

(

"path" = "abfss://selena-container@selena.dfs.core.windows.net/user_behavior_ten_million_rows.parquet",

"format" = "parquet",

"azure.adls2.storage_account" = "selena",

"azure.adls2.shared_key" = "xxxxxxxxxxxxxxxxxx"

);

После завершения загрузки вы можете запросить таблицу, чтобы убедиться, что данные были загружены в неё. Пример:

SELECT * from user_behavior_declared LIMIT 3;

Система возвращает результат запроса, аналогичный следующему, указывающий, что данные были успешно загружены:

+--------+---------+------------+--------------+---------------------+

| UserID | ItemID | CategoryID | BehaviorType | Timestamp |

+--------+---------+------------+--------------+---------------------+

| 142 | 2869980 | 2939262 | pv | 2017-11-25 03:43:22 |

| 142 | 2522236 | 1669167 | pv | 2017-11-25 15:14:12 |

| 142 | 3031639 | 3607361 | pv | 2017-11-25 15:19:25 |

+--------+---------+------------+--------------+---------------------+

Проверка прогресса загрузки

Вы можете запросить прогресс заданий INSERT из представления loads в Information Schema Selena. Эта функция поддерживается начиная с версии v1.5.2. Пример:

SELECT * FROM information_schema.loads ORDER BY JOB_ID DESC;

Для получения информации о полях, предоставляемых в представлени�и loads, см. loads.

Если вы отправили несколько заданий загрузки, вы можете фильтровать по LABEL, связанному с заданием. Пример:

SELECT * FROM information_schema.loads WHERE LABEL = 'insert_f3fc2298-a553-11ee-92f4-00163e0842bd' \G

*************************** 1. row ***************************

JOB_ID: 10193

LABEL: insert_f3fc2298-a553-11ee-92f4-00163e0842bd

DATABASE_NAME: mydatabase

STATE: FINISHED

PROGRESS: ETL:100%; LOAD:100%

TYPE: INSERT

PRIORITY: NORMAL

SCAN_ROWS: 10000000

FILTERED_ROWS: 0

UNSELECTED_ROWS: 0

SINK_ROWS: 10000000

ETL_INFO:

TASK_INFO: resource:N/A; timeout(s):300; max_filter_ratio:0.0

CREATE_TIME: 2023-12-28 15:37:38

ETL_START_TIME: 2023-12-28 15:37:38

ETL_FINISH_TIME: 2023-12-28 15:37:38

LOAD_START_TIME: 2023-12-28 15:37:38

LOAD_FINISH_TIME: 2023-12-28 15:39:35

JOB_DETAILS: {"All backends":{"f3fc2298-a553-11ee-92f4-00163e0842bd":[10120]},"FileNumber":0,"FileSize":0,"InternalTableLoadBytes":581730322,"InternalTableLoadRows":10000000,"ScanBytes":581574034,"ScanRows":10000000,"TaskNumber":1,"Unfinished backends":{"f3fc2298-a553-11ee-92f4-00163e0842bd":[]}}

ERROR_MSG: NULL

TRACKING_URL: NULL

TRACKING_SQL: NULL

REJECTED_RECORD_PATH: NULL

ПРИМЕЧАНИЕ

INSERT — это синхронная команда. Если задание INSERT всё ещё выполняется, вам нужно открыть другую сессию, чтобы проверить его статус выполнения.

Использование Broker Load

Асинхронный процесс Broker Load обрабатывает подключение к Azure, извлечение данных и сохранение данных в Selena.

Этот метод поддерживает следующие форматы файлов:

- Parquet

- ORC

- CSV

- JSON (поддерживается начиная с версии v1.5.2)

Преимущества Broker Load

- Broker Load выполняется в фоновом режиме, и клиентам не нужно оставаться подключёнными для продолжения задания.

- Broker Load предпочтителен для длительных заданий, тайм-аут по умолчанию составляет 4 часа.

- В дополнение к форматам файлов Parquet и ORC, Broker Load поддерживает формат файлов CSV и формат файлов JSON (формат файлов JSON поддерживается начиная с версии v1.5.2).

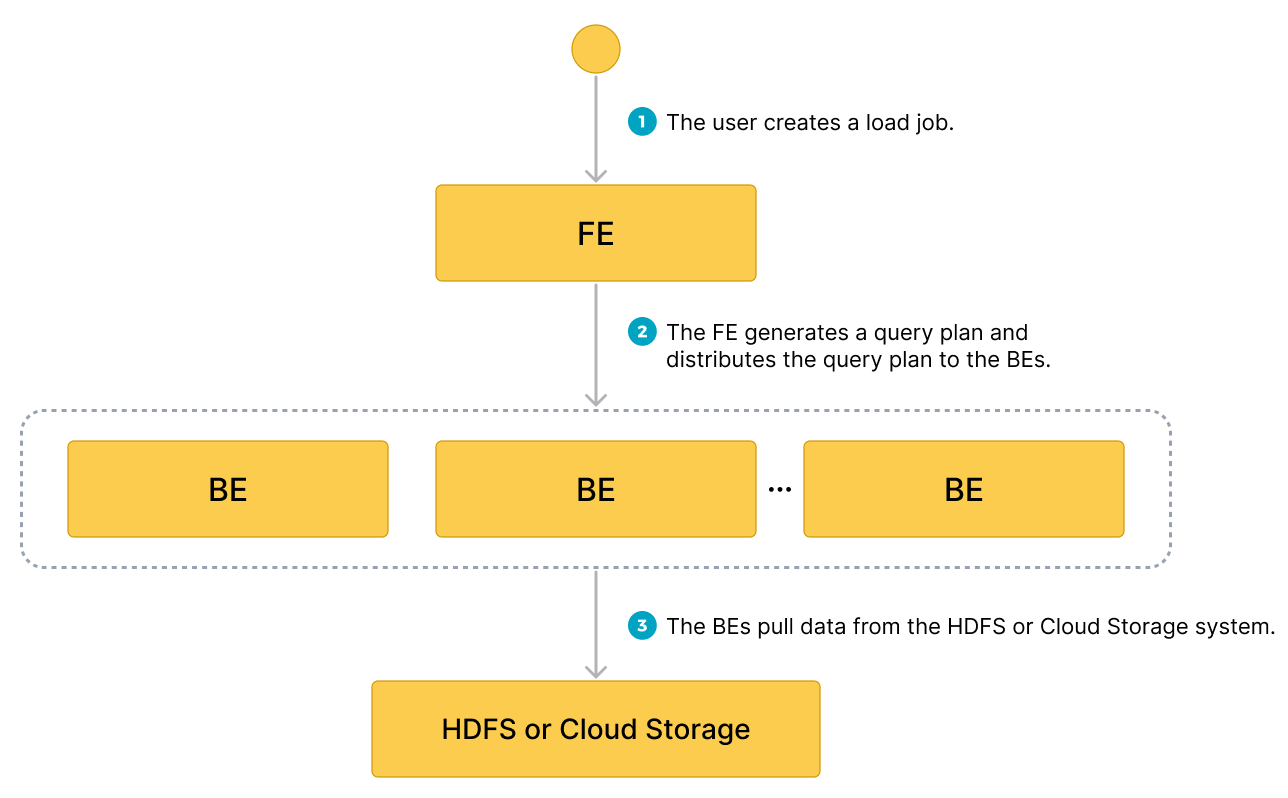

Поток данных

- Пользователь создаёт задание загрузки.

- Frontend (FE) создаёт план запроса и распределяет план на backend-узлы (BE) или compute-узлы (CN).

- BE или CN извлекают данные из источника и загружают данные в Selena.

Типичный пример

Создайте таблицу, запустите процесс загрузки, который извлекает пример набора данных user_behavior_ten_million_rows.parquet из Azure, и проверьте прогресс и успешность загрузки данных.

Создание базы данных и таблицы

Подключитесь к вашему cluster Selena. Затем создайте базу данных и переключитесь на неё:

CREATE DATABASE IF NOT EXISTS mydatabase;

USE mydatabase;

Создайте таблицу вручную (мы рекомендуем, чтобы таблица имела ту же схему, что и файл Parquet, который вы хотите загрузить из Azure):

CREATE TABLE user_behavior

(

UserID int(11),

ItemID int(11),

CategoryID int(11),

BehaviorType varchar(65533),

Timestamp varbinary

)

ENGINE = OLAP

DUPLICATE KEY(UserID)

DISTRIBUTED BY HASH(UserID);

Запуск Broker Load

Выполните следующую команду, чтобы запустить задание Broker Load, которое загружает данные из примера набора данных user_behavior_ten_million_rows.parquet в таблицу user_behavior:

LOAD LABEL user_behavior

(

DATA INFILE("abfss://selena-container@selena.dfs.core.windows.net/user_behavior_ten_million_rows.parquet")

INTO TABLE user_behavior

FORMAT AS "parquet"

)

WITH BROKER

(

"azure.adls2.storage_account" = "selena",

"azure.adls2.shared_key" = "xxxxxxxxxxxxxxxxxx"

)

PROPERTIES

(

"timeout" = "3600"

);

Это задание имеет четыре основных раздела:

LABEL: Строка, используемая при запросе состояния задания загрузки.LOADdeclaration: URI источника, формат исходных данных и имя целевой таблицы.BROKER: Данные подключения к источнику.PROPERTIES: Значение тайм-аута и любые другие свойства, применяемые к заданию загрузки.

Подробный синтаксис и описание параметров см. в BROKER LOAD.

Проверка прогресса загрузки

Вы можете запросить прогресс задани�й Broker Load из представления loads в Information Schema Selena. Эта функция поддерживается начиная с версии v1.5.2.

SELECT * FROM information_schema.loads \G

Для получения информации о полях, предоставляемых в представлении loads, см. loads.

Если вы отправили несколько заданий загрузки, вы можете фильтровать по LABEL, связанному с заданием:

SELECT * FROM information_schema.loads WHERE LABEL = 'user_behavior' \G

*************************** 1. row ***************************

JOB_ID: 10250

LABEL: user_behavior

DATABASE_NAME: mydatabase

STATE: FINISHED

PROGRESS: ETL:100%; LOAD:100%

TYPE: BROKER

PRIORITY: NORMAL

SCAN_ROWS: 10000000

FILTERED_ROWS: 0

UNSELECTED_ROWS: 0

SINK_ROWS: 10000000

ETL_INFO:

TASK_INFO: resource:N/A; timeout(s):3600; max_filter_ratio:0.0

CREATE_TIME: 2023-12-28 16:15:19

ETL_START_TIME: 2023-12-28 16:15:25

ETL_FINISH_TIME: 2023-12-28 16:15:25

LOAD_START_TIME: 2023-12-28 16:15:25

LOAD_FINISH_TIME: 2023-12-28 16:16:31

JOB_DETAILS: {"All backends":{"6a8ef4c0-1009-48c9-8d18-c4061d2255bf":[10121]},"FileNumber":1,"FileSize":132251298,"InternalTableLoadBytes":311710786,"InternalTableLoadRows":10000000,"ScanBytes":132251298,"ScanRows":10000000,"TaskNumber":1,"Unfinished backends":{"6a8ef4c0-1009-48c9-8d18-c4061d2255bf":[]}}

ERROR_MSG: NULL

TRACKING_URL: NULL

TRACKING_SQL: NULL

REJECTED_RECORD_PATH: NULL

После того как вы убедитесь, что задание загрузки завершено, вы можете проверить подмножество целевой таблицы, чтобы увидеть, были ли данные успешно загружены. Пример:

SELECT * from user_behavior LIMIT 3;

Система возвращает результат запроса, аналогичный следующему, указывающий, что данные были успешно загружены:

+--------+---------+------------+--------------+---------------------+

| UserID | ItemID | CategoryID | BehaviorType | Timestamp |

+--------+---------+------------+--------------+---------------------+

| 142 | 2869980 | 2939262 | pv | 2017-11-25 03:43:22 |

| 142 | 2522236 | 1669167 | pv | 2017-11-25 15:14:12 |

| 142 | 3031639 | 3607361 | pv | 2017-11-25 15:19:25 |

+--------+---------+------------+--------------+---------------------+